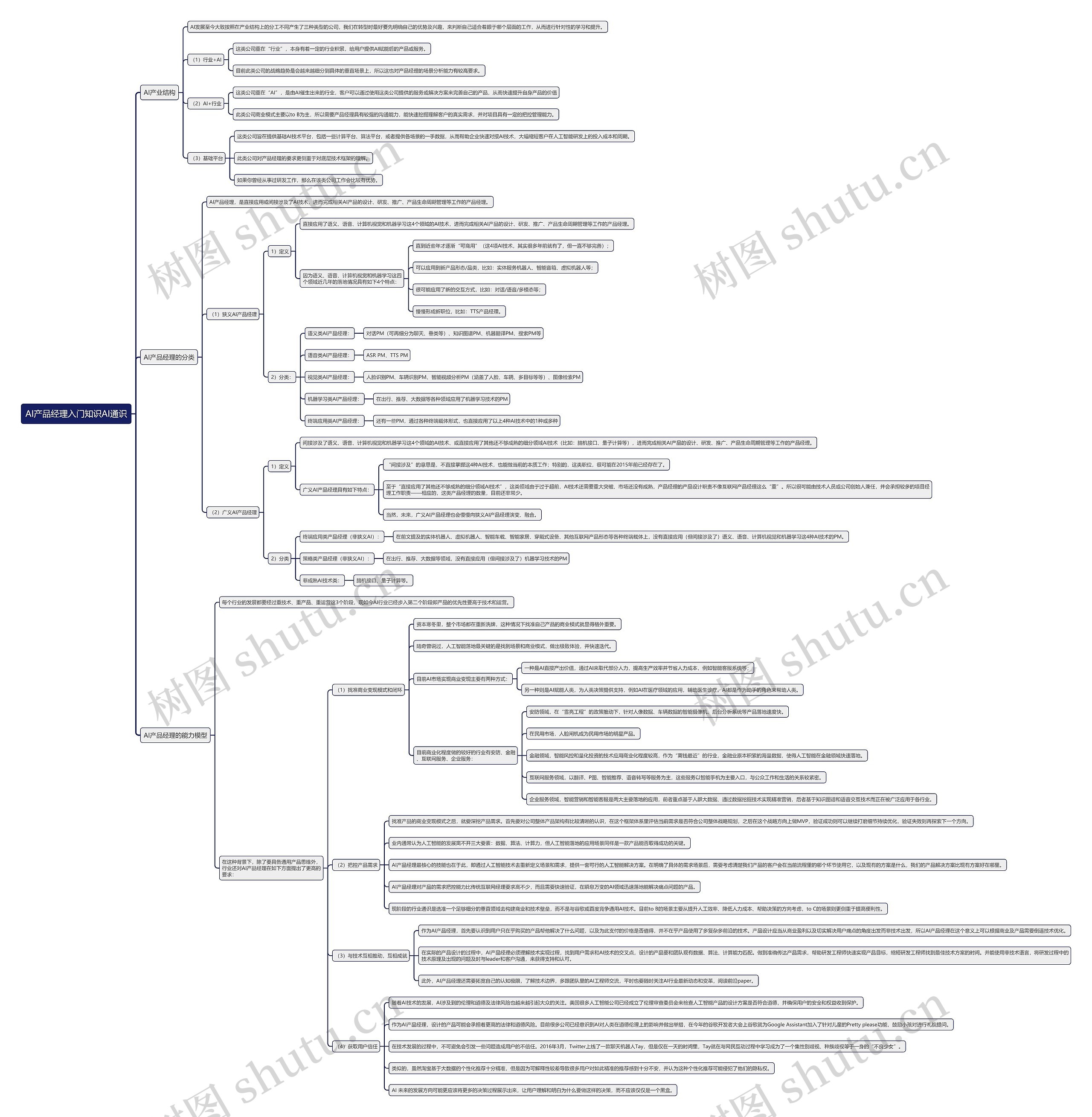

AI产品经理入门知识AI通识思维导图

Yyyy

2022-11-07

AI产品经理入门知识AI通识概括总结思维导图

树图思维导图提供《AI产品经理入门知识AI通识》在线思维导图免费制作,点击“编辑”按钮,可对《AI产品经理入门知识AI通识》进行在线思维导图编辑,本思维导图属于思维导图模板主题,文件编号是:280c8c171947552dbbdc5f2ed60f0fa6

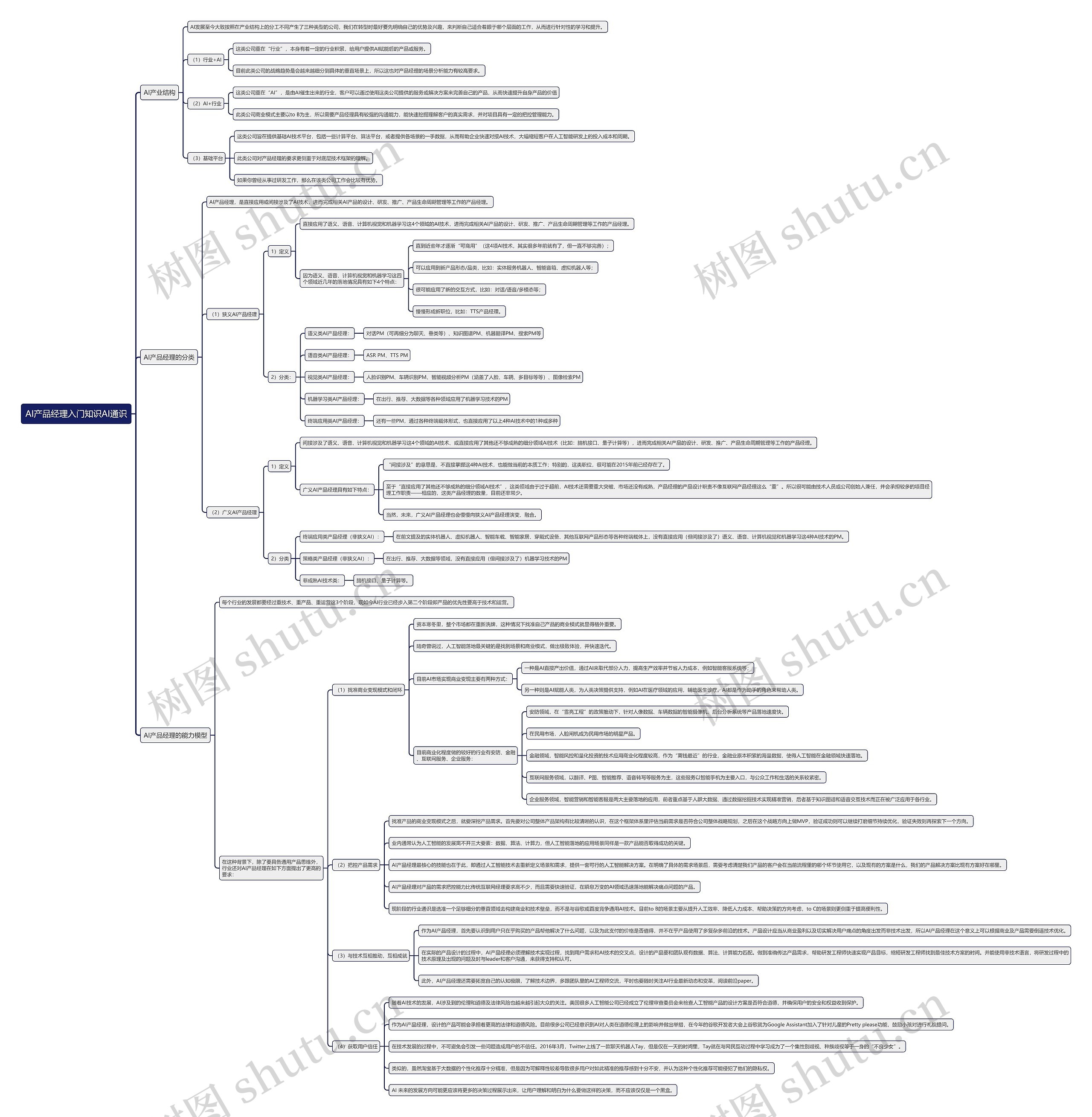

AI产品经理入门知识AI通识概括总结思维导图

树图思维导图提供《AI产品经理入门知识AI通识》在线思维导图免费制作,点击“编辑”按钮,可对《AI产品经理入门知识AI通识》进行在线思维导图编辑,本思维导图属于思维导图模板主题,文件编号是:280c8c171947552dbbdc5f2ed60f0fa6