左手技术右手管理范文通用8篇思维导图

青衣衫

2023-05-08

左手技术右手管理范文通用8篇

左手技术右手管理范文 第一篇有一天,一个小男孩在房间里做作业,右手拿着笔写字,而左手扶着作业本写着写着,突然右手骄傲地对左手说:“左手兄弟,你看!我写的字儿多好看呀!”左手冷笑着说∶“如果没有我给你扶着本子你还能写漂亮吗?”右手听左手怎么一说就心里不开心了∶哼,没了你我还是一样可以写得漂亮,你就是羡慕我你才会这样说的。

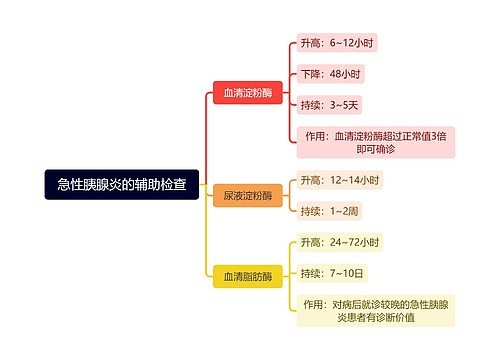

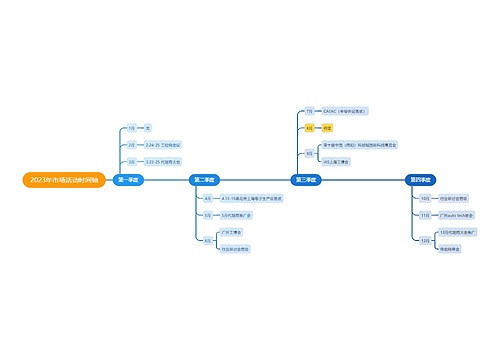

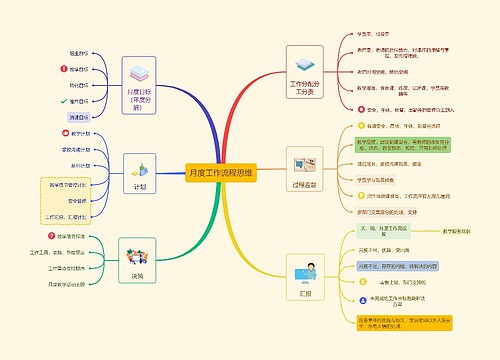

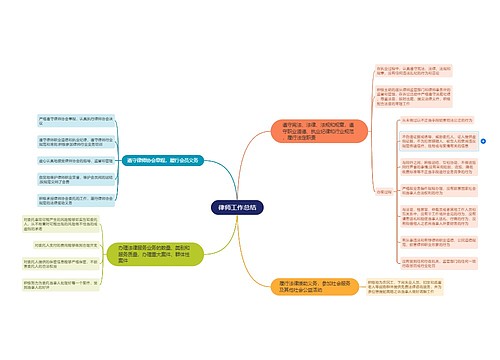

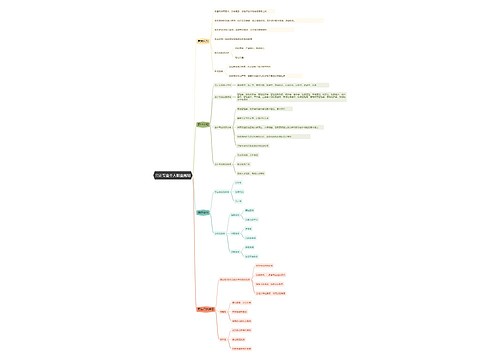

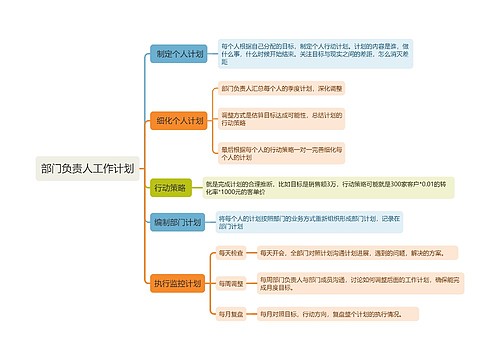

树图思维导图提供《左手技术右手管理范文通用8篇》在线思维导图免费制作,点击“编辑”按钮,可对《左手技术右手管理范文通用8篇》进行在线思维导图编辑,本思维导图属于思维导图模板主题,文件编号是:3a9480feefe6db1651377cec28c36dae

思维导图大纲

相关思维导图模版

左手技术右手管理范文通用8篇思维导图模板大纲

左手技术右手管理范文 第一篇

有一天,一个小男孩在房间里做作业,右手拿着笔写字,而左手扶着作业本

写着写着,突然右手骄傲地对左手说:"左手兄弟,你看!我写的字儿多好看呀!"左手冷笑着说∶"如果没有我给你扶着本子你还能写漂亮吗?"右手听左手怎么一说就心里不开心了∶哼,没了你我还是一样可以写得漂亮,你就是羡慕我你才会这样说的。

第二天,小男孩要搬家了,他正在帮妈妈抬书桌,右手因为昨天的事还在生气,他在和左手搬书桌的时候灵机一动,他终于知道该如何"报复"左手了。他假装一滑,"砰"的一声响,书桌重重地砸向了左手,小男孩痛地蹲在地上,小男孩的妈妈看见了,连忙带着小男孩去医院诊治……

左手因为被书桌砸断了骨头,所以他被医生安置在一个"吊"起来的小病床上安安心心的"养病"。因为左手"生病"了,所以小男孩不得不暂时离开他心爱的校园住进医院,让左手快点好起来。虽然住进医院但是小男孩的妈妈为了让小男孩跟上学校老师上课的进度,她还特意把作业拿到医院让小男孩做,右手拿起笔写了起来,可是,因为没有左手扶着本子,所以本子一会歪过去,一会歪过来。现在右手写的字更原来的字有着天壤之别,右手很无奈,他想∶我为什么因为争一口气而伤了我最要好的伙伴呢?我真是不应该呀!

到了晚上,夜深人静的时候,右手忽然对左手说∶"左手兄弟,你还没睡吧?"

"没呢。右手兄弟有事吗?"

"我想向你道歉"

"为什么呢?你又没做错什么?"

右手倒吸一口冷气,将那天的事原原本本地告诉了左手,最后他小心翼翼地问∶"你能原谅我吗?""当然可以,我的好伙伴!而且我也没有怪你什么。"左手笑着说……

从那以后,右手和左手变成了一对很要好的朋友,他们团结一心,帮助小主人写出了很多很多漂亮的字,这些都是他们两共同的功劳。

他们经过这件事明白了:只要团结一心,再难得事也能做到。

左手技术右手管理范文 第二篇

翻阅着这本厚厚的日记,轻轻地弹去时间的尘埃,在某一页上寻找那失落已久的记忆碎片,小心地敲打出那流光的回忆,倾情地抚摸那依稀绯红的梦。在我的眼前,如一轴经年的电影胶片铺展开一条条亮丽的过往和追忆,如莲花般次第开放,炫耀得我还来不及闭眼就已潸然泪下……

——题记

梦境的开始

开学了,我们都带着对未来的憧憬走进了高中的校园,在同一间教室里,我们一同努力学习,将所有的欢笑化成了动力,只为了圆自己的梦。在寝室里,我们都用心去经营装扮这个家,让它更加温馨。在这间屋子里,有许多让我们难忘的回忆……还记得吗?元旦过后我过生日,你们为了给我一个surprise去买生日蛋糕,拖住我的重任落在了你的身上,当时的你笨笨的带着我在超市里转圈圈,最后什么也没有买。那时我们在快乐的同时都没有想到一场危机已经来临……

固执的坚持

如果说友谊必须要有一段叩人心扉的注脚,我想它应该是成长,如果它注定有一段刻骨铭心的旁白,我希望那个下午我们什么都没有说,只是静静地坐着,不给对方一个承诺。当我们各自谈论着新的班级,新的生活,诉说着各自的烦恼时,给彼此一个保证。你食言时我很生气,我不相信承诺那么脆弱,那么不堪一击。我坚持着自己的原则,任谁劝我也不肯先低头,但是你我有多少次拿起手机,看着熟悉的号码,拨出又挂断,因为我们都在怕,不知不觉间,我们错过了最好的时机。

重拾的美好

那一纸繁华是落不尽的花红,是看不够的灿烂缤纷,那一纸寂寞时飘不过的清雅,是抵不过的柔情脉脉。晚自习下课,你面带笑容向我走来,我的脸上也有了笑容。冷战在微笑里消失,一同走在操场上,心中的感情难以形容。一遍遍的诉说,一遍遍的重复着同一句话。课上我的指尖轻轻的滑过文字,这是一段充满阳光的岁月,于是我懂得了珍惜,学会了用一颗平常心去看云卷云舒,花开花落。

风吹起如花般破碎的流年,那些记忆将成为我成长旅途中最美的点缀。看天,看雪,看左手季节深深的倒影,看右手悄然逝去的年华。

左手技术右手管理范文 第三篇

深夜,小主人睡得很熟。一只蚊子飞进屋子里,它看见小主人的右手白白胖胖的,心中大喜,飞快地降落在右手上,准备享用一顿美餐。

右手被猛地一下扎醒了,十分痒痒,连忙把左手拍醒:"兄弟,快帮帮忙!"左手没好气地说:"唉!老兄,深更半夜叫醒我干什么?"说着,又呼呼大睡,右手急忙说:"老弟,蚊子正喝我血呢!你总不能见死不救吧!"左手不急不慢地说:"老兄,主人有什么事总是让你做,什么好处也是你先得。你不是老在我跟前炫耀吗?我还真羡慕呢!嘿嘿!现在有求于我了,真让我这个当弟弟的受宠若惊呀!"右手痒得不行了,全身立即变红,它见和左手没什么好说的,只好忍着性子与蚊子谈判。右手"毕恭毕敬"地咬着牙说:"亲爱的蚊子大侠,我求求你,飞往别处去吧,那里还有好多美食呢!"蚊子嬉皮笑脸地说:"这么白胖的小手,我可不愿意放过这丰盛的晚餐哦!不过看在你对我这么忠诚的份上,嘿嘿,吃完这顿再去其它地方吃夜宵罗。""啊?!"右手已经快没力气了,只好做出最后挣扎……

终于,左手被蚊子吵得连做梦也不香了,右手趁热打铁,用它那微弱的声音说:"好兄弟,我们俩可是难分家的。相必这只蚊子的美餐策略是唇亡齿寒,紧接着你就会成为它的美食。"左手只好代表疲惫不堪的右手对蚊子宣战:"蚊子,你不要欺人太甚,你可要好自为之,否则就会死在我的手下!"蚊子摆出一副天不怕地不怕的架势,说:"你来吧!我相信,一个巴掌拍不响。右手已经被我折腾得筋疲力尽!哈哈!你一定制服不了我!"左手受不了蚊子的冷嘲热讽,一边说一边愤怒地拍向蚊子。"啪"地一声,蚊子顿时脑血四溢,倒在血泊里。再看看右手,它似乎已经瘦了一圈。左手不敢相信眼前的一切,自己迫不得已打了一下可以让蚊子进天堂!左右手俩兄弟互相对视了一眼,笑了。

天渐渐发白,小屋里又发出了左右手那轻微的呼吸声。

左手技术右手管理范文 第四篇

左岸是我无法忘却的回忆,右岸是值得我紧握的璀璨年华,而中间飞快流淌的,是我年年岁岁淡淡的感伤。

——小四

左手,握着我们的回忆,无法忘却的回忆。细腻的犹如细纱,轻轻的在指间流去,从手指的空隙间,滑落。轻柔的掉下,落地没有一丝声响,没有一点火花。就像沙漏一样,一点一点的流逝。这些支离破碎的记忆拼凑到一起,组成一个又一个零散的记忆场面。夜夜铺天盖地的涌入我的梦里,一次又一次上映同样的场景。"那些曾经以为念念不忘的事情就在我们念念不忘的过程里,被我们遗忘了。"对于这句话,我不会质疑。这些我一直以为无法去忘却的事情,随着沙漏的流逝也渐渐不再清晰了。或许,在某一天这些不清晰的轮廓也会淡去。左手倒影,埋藏了好多回忆,它会随着右手飞一样的年华而化为真正的模糊的倒影。

右手,攥着我们璀璨的年华,正是耀眼。我不住的去回望左手边的倒影,就这样,年华也在飞逝。然后再踏入正常的轨迹。埋头题海,偶尔在教室里看着那反射在书本上的明媚,柔和的光线,就会觉得恍惚,失神。偶然的抬头看着和自己一样的90后的孩子。没有什么负担的在校外自由的走动,在阳光下肆意的欢笑,心就会一点一点的'痛。我知道,对于他们的自由,我只能是羡慕,却可望不可即。我清楚的知道,还有好多好多事情在等着我。我没有那么多青春可以去挥霍。右手的年华,正值我们去珍惜的时光。要让它闪现出更加与众不同的耀眼。

仰望着夜空,看着天上的闪烁的星星和散发着柔和之光的月亮,有些惆怅涌入心底。是我们所不该有的伤感。它像一条河流,平静地穿过我的岁月。我把左手和右手重合在一起,我知道,它们对我的重要。对于,左手边的倒影,我只愿用心去凝记。对于右手边的年华,我只愿用心去谱写。左手倒影,右手年华。抓住我们璀璨耀眼的现在,不想以后,微笑着出发,开始从新的旅程。

左手技术右手管理范文 第五篇

性别、年龄、情绪等特征可能是计算生存率的部分数据,但机器人是怎么进行决策的,目前的人工智能系统很难解释。

换句话说,人们知其然而不知其所以然。

以现在非常火热的深度学习为例,其决策场景下的模型可解释性很差,具体表现为:输入特征与输出结果之间存在一个无法观测的"黑箱"空间。

比如,阿尔法狗在与柯洁的对弈中,其每一步都是动态的,谷歌只下达了"赢得比赛"的指令,但阿尔法狗是如何根据柯洁的落子来决定对策从而赢得比赛,人们却无从得知。

这种不可解释性对于非常重要的场景,比如交通、金融、医疗等,是一种巨大的安全隐患。人们无法从人工智能系统决策过程中获取有效信息,进而也无法快速对系统进行优化,避免可能导致的利益损失。

另一个重要的点:机器人在救人过程中是否涉嫌"算法歧视"?也就是人工智能系统的公平性问题。

人工智能算法会受到训练数据的影响,如果训练数据中存在偏见,那么其决策也会形成歧视。

电影里的机器人在面对男女性别差异时,作出的决策有没有偏见,这一点无从得知。但现实生活中,美国芝加哥法院曾采用的犯罪风险评估系统(COMPAS)被证明对黑人存在歧视。

如果一个黑人犯了罪,他被该系统错误地标记为具有高犯罪风险的可能性更大,因此可能会被法官判处更长的刑期。

更为普遍的例子是,人们所熟知的大数据杀熟,实际上是根据用户特征/偏好数据形成的价格歧视。

从经济学角度上讲,价格歧视并非贬义,比如老人小孩乘坐公交车享受比成人更低的价格优惠。

但对于人工智能系统而言,基于数据训练形成的价格歧视,根据用户购买行为、性别等进行分层,从而给新用户以优惠,给老用户「高贵」,这种歧视无法可依,本身影响了「消费者公平」。

除了可解释性、公平性之外,AI的安全性、稳健性等问题也引发人们对AI的信任危机。

安全性表现在AI如何保护数据安全。过去一段时间里,Google、Meta等公司先后被爆出数据泄露问题,引发全球对数据保护的关注,各国也加快了针对隐私、数据保护方面的立法。

稳健性则是指人工智能系统在异常情况下,仍能保持正常运行,而不至于崩溃。例如,现在的智能驾驶都有一套「冗余」方案,目的是防止极端天气、车辆碰撞等场景下,车辆失控的情况。

但目前人工智能系统的稳健性,还有待增强。

基于不可解释性、公平性、安全性、稳定性等问题,AI需要面临的最后一道门槛是:人工智能到底能不能成为责任主体?

也就是说,人工智能因技术缺陷带来的不良后果,谁来背锅?软件开发商还是所有者?

《机械公敌》中,机器人桑尼杀死了自己的"父亲"朗宁博士,真相大白以后主角史普纳警官却没有对桑尼提起诉讼,因为桑尼并非人类,处于人类法律的界限之外。

上述的问题实际上造成了普通大众对于人工智能的「信任危机」,然而直到现在,尚且没有一部成型的法律来对人工智能进行规制。

不过,从学界、产业界以及政府等多方的实践之中,仍能看到有益的探索。

左手技术右手管理范文 第六篇

以人工智能公司旷视为例:

在顶层设计方面,2019年7月,旷视公布了基于企业自身管理标准的《人工智能应用准则》,从正当性、人的监督、技术可靠性和安全性、公平和多样性、问责和及时修正、数据安全与隐私保护六个维度,对人工智能正确有序发展作出明确规范。

与此同时,旷视还参加了多个国家及行业规范标准制定,例如《新一代人工智能治理原则》、《新一代人工智能伦理规范》等,并成为国内率先通过隐私保护国际标准ISO/IEC 27701的人工智能企业。

在内部管理上,旷视主要从企业制度和架构两方面进行管理。

架构:2019年8月,作为业内首个成立"人工智能道德委员会"的AI公司,旷视聚焦于研讨、制定公司相关伦理道德治理的规章与管理机制,并对公司业务中涉及到的重大伦理问题进行决议;

2020年1月,旷视又成立AI治理研究院,旨在联合国内顶尖研究机构,积极探索AI道德伦理与治理工作的落地路径。

制度:除了发布《人工智能应用准则》这类纲领性文件,旷视还出台了《数据分类分级管理规范》、《员工信息安全守则》等细则,在内部形成规范化管理。

与此同时,旷视倡导客户遵循《数据安全声明》、《正确使用人工智能产品倡议书》,形成行业「合力」。

对于技术攻关,旷视目前主要集中在数据安全和隐私保护、算法的安全性、稳健性等问题。

例如,旷视研发的前端图像脱敏方案,是目前业内率先实现在采集端就能完成人脸图像的不可逆脱敏,来加强个人信息保护。

而在AI基础平台研发上,旷视主张通过研发面向数据安全和隐私保护的AI平台,实现从需求提出到交付的全流程一体化数据安全及隐私保护,相关成果将进行试点推广。

值得一提的是,旷视还联合人民智库、中国人工智能产业发展联盟等专业机构、组织,发布"全球十大人工智能治理事件"评选榜单,以议题设置的方式,联动各方对AI治理进行持续关注与深度讨论,通过多元交流,共同推动AI治理走向规范化。

目前,该榜单已持续三届,针对2021年度全球十大人工智能治理事件,来自不同领域的专家表达了类似的观点。

中国信息通信研究院副总工程师、中国人工智能产业发展联盟副秘书长王爱华认为,2021年是全球人工智能治理极具实质性突破的一年,纵观全年的治理事件,全球人工智能治理呈现出"趋实、趋严、趋细"三大特点。

清华大学公共管理学院教授、人工智能国际治理研究院副院长梁正同样表示,人工智能治理已经成为全球共识,且已从理念层面进入到建章立制、落地实施的阶段。

从旷视的人工智能治理探索中不难发现,多数企业采取的是自上而下的方式,即建立规章制度,先保证企业自身的技术、制度合规性,再通过企业实践和行业研讨来共识产业方向。

而在当下的人工智能治理中,自下而上的基于应用主体和用户选择的参与,也成为人工智能治理的一个重要方法。

需要指明的是,当前的AI治理仍然处于探索期,如何引导人工智能进一步规范发展,仍有待市场经济环境下,供给、需求、监管等多方在「磨合」后,达成「共识」。

正如旷视联合创始人兼CEO印奇所言:"AI不仅要在技术创新和应用落地上下功夫,也需在治理上使力气,这离不开所有AI从业者和社会各界的共同努力。"

左手技术右手管理范文 第七篇

"五个兄弟并排站,模样有别个(儿)不齐,名字不同本领大,请你猜猜它是啥?"小朋友,你猜出来了吗?对对!它就是咱们的手呀!今天,我就给大家讲一个手的故事。

左手和右手是兄弟,右手大一些,是哥哥,左手小一些,是弟弟。他们哥俩亲密无间,配合默契。瞧!他们俩帮主人铺床叠被、洗脸刷牙、穿衣戴帽……左手脏了,右手赶紧帮着洗,右手不小心弄疼了,左手又是抚摩又是上药,心疼极了……

俗话说:牙齿和舌头还打架呢,再好的兄弟也有闹矛盾的时候。这不,你瞧!手兄弟俩也吵上了。右手哥哥气得脸儿通红,左手弟弟也正苦恼着呢!这时,一只小蚊子"嗡嗡"地飞来了,它在左手小弟的背上叮了一个大包,好痒啊!左手便对右手说:"大哥,快帮我挠挠吧!我痒得受不了了。""自己的事情自己干!"右手大哥没好气地说。左手弟弟自个儿折腾了半天也没有挠到。突然,一只花蚊子在右手背上也叮了个大包。右手大哥感觉奇痒无比,便不好意思地说:"小弟……我……我也……痒,你……你……帮我挠挠?""去去去!自己的事情自己干!这是谁说的?"小弟也不买账。右手顿时哑口无言。

这样,他俩闹别扭快一个星期了。终于,不幸的事情发生了,就在星期天的早晨,小主人骑着自行车在马路上行驶着。要拐弯了,可右手要往右,左手要往左,最后,小主人摔倒了,"咔嚓"一声,左手骨折了。这下,医生把左手包得严严实实,只露出一根手指头透气,然后被长长的绷带挂在小主人的脖子上。

自从左手受伤后,右手做什么都不方便。瞧,该吃饭了,右手握着筷子一会儿要夹菜,一会儿要喝汤,才吃了一半,就碰翻了桌上的饭碗。"啪"的一声,砸在小主人的脚上,烫得主人"哇哇"叫,还直数落着右手:"你这没用的东西!"右手听了,心里难受极了,他叹了一口气,说:"唉!没有左手小弟的日子真难熬啊!"

折腾了一个月,左手终于康复了,还没等小弟把绷带全甩光,右手大哥就和左手小弟紧紧拥抱在一起,他俩都泪流满面,互相诉说着失去对方的痛苦。

从此,手兄弟俩再也不闹别扭了,他俩和好如初,认认真真地为小主人服务。

左手技术右手管理范文 第八篇

爷爷的手,拿得起粪叉,舞得了笔杆。

爷爷是一个农人,他常常"晨兴理荒秽,带月荷锄归",却从没有过"草盛豆苗稀"。因为他精通耕种之道,不滑不懒;最重要的是,他施用农家肥。每天晨曦初露,爷爷便背一竹篓,操一粪叉,游走于村头巷尾,捡拾牲畜秽物。及至天一放亮,村郊不上不下地被飘来的炊烟裹住,爷爷就回家。奶奶摆好了早饭,小米粥、馒头、青椒、拍黄瓜!呼噜呼噜喝完汤,顺便踢走死缠脚下的巴儿狗……偶尔奶奶也夸一夸爷爷捡来的大粪:"这肥好,臭!"老头老太太对视一眼,笑了。

爷爷曾是个大学生,当官的,有过出息。太爷爷共有六子,本来都该安安分分做个小农民,但爷爷不。他天分异常好,私学,中学,及至大学,都是一路直上。后来当了小官,虽不大,但在镇上也算是有头有脸了,在村里更是红极一时。眼看升官在望,爷爷却收拾行囊,携家带口,回了村里。村里人都表示理解:"对喽,农民好嘛,看看庄稼看看草,啥都不愁。"

村里人称赞爷爷的农活,还敬佩爷爷的书法。逢年过节,红白大事儿,都找爷爷来写字儿。不必狼毫,不必端砚,更不必宣纸——乡下人也不懂欣赏这个,但他们都知道爷爷见多识广,高文凭,有技艺。对于求字之人,爷爷总是来者不拒,放下粪叉,洗手执笔,挥洒而下。当淳朴的邻人拿到字后,喜悦之情全溢于脸上,总想夸一夸这字儿——就像汪曾祺笔下的乡亲们一样:"这字儿好,真黑!" 我是爷爷的长孙,却去之远矣!常问爷爷:"您咋就愿意做个农民呢?"他总会拿他喜欢的文人汪曾祺做例子:"你看啊,老汪这人写文章写得好。俗而不厌,多而不滥。为啥?他虽是文人,却也近于农人。勤恳、淳朴、达观。"我点头:"是啦,他也掏过粪,而您是叉粪。又都是执笔之人,又都上过大学。您和汪先生差不多嘛!"爷爷很得意我的说法,却仍摆手不赞同:"有一点不一样,他种地不如我。"奶奶看我们爷孙俩笑闹,总是很无奈,叹道:"这老头子。"

我不知道我何时会有这种高度,更不知道爷爷眼里的世界是怎样,但我深知,爷爷表现的那些,才是人们应该追求的粪叉和笔杆共存的境界。

平淡而知足,是爷爷的智慧。

查看更多

相似思维导图模版

首页

我的文件

我的团队

个人中心